Il risultato da record è stato descritto a fine Luglio nel Morning Post del Sud della Cina ed è stato ottenuto dal gruppo di cosmologia computazionale degli Osservatori Astronomici Nazionali dell’Accademia Cinese delle Scienze, guidati da Gao Liang. Il gruppo ha utilizzato il supercomputer TaihuLight, una macchina straordinaria (e i cinesi ci stanno abituando a simili meraviglie) interamente realizzata in Cina, a partire dai processori di progettazione nazionale. (1)

Credit: Imaginechina / Rex / Shutterstock

L’esecuzione della simulazione è avvenuta nel mese di Maggio e, come la maggior parte dei codici utilizzati per modellizzare l’universo, si basava sulla “simulazione degli N corpi”, che approssima il movimento delle particelle guidate principalmente dalle forze gravitazionali. Il problema classico ha soluzioni analitiche complete solo nel caso di due corpi, mentre per n=3 esistono soluzioni soltanto per casi particolari (quelli che ad esempio portano a formulare il modello Lagrangiano con i famosi punti di librazione). In tutti gli altri casi, è necessario ricorrere a una soluzione numerica ovvero una simulazione, la cui complessità cresce rapidamente con il numero n di particelle poiché ciascuna di esse interagisce con tutte le altre. Negli anni ’70, è stato possibile simulare oltre 1000 particelle con i migliori computer disponibili e a quell’epoca fu celebre il lavoro pieneristico dei fratelli Toomre, che effettuarono le prime simulazioni di interazione gravitazionale tra galassie spiegandone le forme peculiari.

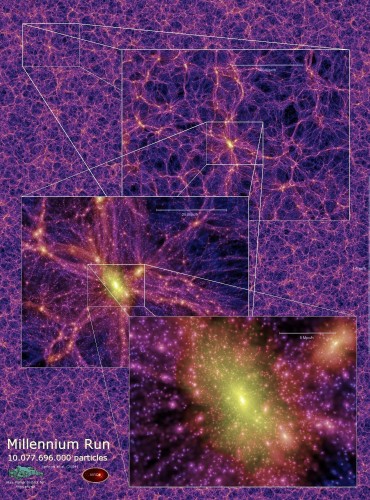

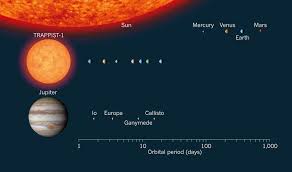

Una simulazione cosmologica celebre è quella effettuata nel 2010 dalla NASA, chiamata Bolshoi ed effettuata sul supercomputer Pleiades. Essa utilizzava un insieme di 8.6 miliardi di particelle all’interno di un cubo ampio 1 miliardo di anni luce (dimensioni attuali, più piccole in passato) e ne seguiva l’evoluzione da circa 20 milioni di anni dopo il Big Bang fino ad oggi. Tre anni dopo, una simulazione più accurata (Bolshoi-Planck simulation) servì a simulare e spiegare le caratteristiche del fondo cosmico di micro-onde osservate dal satellite europeo Plank. Già nel 2005 il consorzio internazionale Virgo aveva effettuato una simulazione analoga su 10 miliardi di particelle, il Millenium Run.

Negli ultimi anni gli scienziati hanno raggiunto il livello di 1 trilione (1012) di particelle su alcune delle macchine più potenti del mondo come il Titan negli Stati Uniti, il computer K in Giappone e Tianhe-2 a Guangzhou.

La simulazione dell’universo TaihuLight ha infranto il record ottenuto a giugno dal supercomputer di “Piz Daint” da 20 petaflop in Svizzera. Il modello svizzero ha usato 2 trilioni di particelle, simulando circa 25 miliardi di galassie durante un calcolo durato 80 ore. Nell’impresa di TaihuLight, la simulazione è durata per poco più di un’ora e, durante questo tempo relativamente breve, ha eseguito il calcolo fino ad alcune decine di milioni di anni dopo il Big Bang. L’età attuale dell’universo è di circa 13,7 miliardi di anni, per cui Gao chiarisce: “questo è solo un esercizio di riscaldamento, abbiamo ancora molto da fare per ottenere quello che vogliamo” !

note:

(1): Per gli appassionati di informatica, il Sunway TaihuLight ha una potenza di calcolo teorica di 125 petaflop (1 PF = 1015 operazioni in virgola mobile al secondo) e una potenza “certificata” di 93 PF, cosa che lo ha fatto salire al primo posto nella classifica mondiale Top500 pubblicata a giugno 2016. Possiede ben 10649600 “cores”, raggruppati in 40960 nodi (ognuno con un processore); assorbe una potenza di picco di 15,4 MWatt, che possono sembrare molti ma che, se rapportati alla potenza di calcolo, ne fanno uno dei più efficienti supercomputer al mondo, con un consumo di un solo Watt ogni 6 Gflop (6 miliardi di operazioni). La macchina è realizzata dal National Research Center of Parallel Computer Engineering and Technology (NRCPC), ed è intallata a Wuxi, una vecchia città non lontana da Shanghai. Il sistema (precedentemente tenuto segreto) ha letteralmente sbaragliato i concorrenti poichè da solo supera le capacità computazionali dei successivi quattro supercomputer nella lista messi insieme! TaihuLight è basato sul processore “ShenWei” SW26010, una CPU a 260 cores sviluppata in Cina specificamente per attività HPC (High Performances Computing), con una architettura e un linguaggio di programmazione originali per aggirare l’embargo tecnologico vigente nei confronti della Cina negli anni passati. In base a quanto annunciato dai competitori, nel prossimo anno un altro supercomputer cinese (Tianhe-2a) e, successivamente, uno americano (Summit) dovrebbero rubargli il primo posto nella classifica, avvicinandosi ai 200 PF di potenza computazionale.

Articolo di Marco di Lorenzo originariamente pubblicato su AliveUniverse.

Ringrazio per la preziosa collaborazione corrado973.

Allora potrei farla anchio quella simulazione; vediamo

Simulando levoluzione di 60 corpi celesti del sistema solare dei giorni nostri vado avanti 5,3 minuti ogni 1,5 secondi di simulazione.

Se invece di 60 corpi ne metto 10 trilioni (1013), per avanzare di quei 5,3 minuti impiegherei poco meno di 2 milioni di miliardi di anni.

Forse con questo paragone è più semplice rendersi conto della capacità di calcolo di quei super-computer.