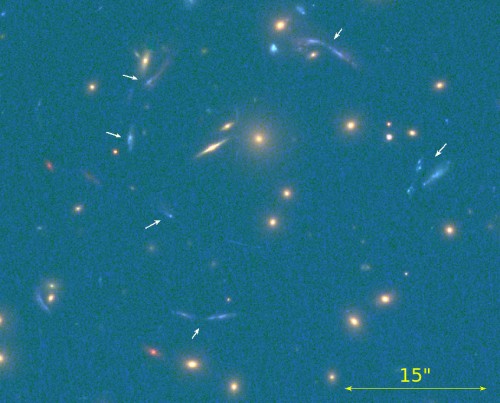

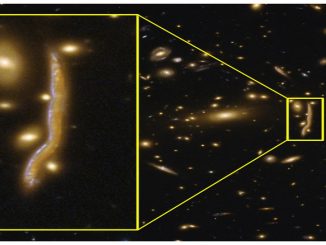

Se fosse un giallo di Arthur Conan Doyle, “lei” – la galassia protagonista di questa storia – reciterebbe la parte dell’indizio. Il ruolo di Sherlock Holmes spetterebbe al Grantecan, il Gran telescopio Canarias (Gtc) che sorge in cima al Roque de los Muchachos, sull’isola di La Palma, alle Canarie. E l’immancabile lente sarebbe un ammasso di galassie a metà strada fra “lei”, la galassia protagonista, e noi che la osserviamo: una lente gravitazionale. Abbastanza potente da far apparire la lontanissima galassia – 10 miliardi di anni luce da noi – circa 11 volte più grande e più luminosa di quanto non la vedremmo senza l’ammasso di mezzo.

Miracolo della gravità. Di quella einsteniana in particolare, che deformando lo spaziotempo, e piegando di conseguenza la traiettoria della luce, fa sì che il nostro sguardo possa spingersi ben oltre i confini che la sola tecnologia saprebbe garantirci. Ma onore anche all’ingegno e alla perseveranza del team di astrofisici dell’Instituto de Astrofísica de Canarias (Iac) e dell’Universidad Politécnica de Cartagena (Upct, Spagna) che ha scoperto la remota galassia – della quale vi risparmiamo l’impronunciabile sigla – soprannominata Cosmic Eyebrow, “sopracciglio cosmico”. Onore all’ingegno e alla perseveranza, dicevamo, perché non è stata una scoperta casuale: per incastrare Cosmic Eyebrow, per sapere in che direzione orientare lo specchio da 10.4 metri del Grantecan, hanno incrociato i dati di due cataloghi d’oggetti compatti, quello della missione WISE della NASA e quello della missione Planck dell’ESA.

Lo sforzo è stato premiato. Cosmic Eyebrow, infatti, non è una galassia qualsiasi: è una galassia iperattiva – nel senso che al suo interno si stanno formando nuove stelle al ritmo impressionante di mille masse solari all’anno (nella nostra vecchia Via Lattea siamo ormai fermi a due masse solari all’anno, per dire) – ed è una galassia ultra-brillante. Addirittura la più brillante fra quelle osservate in banda submillimetrica, visto che ha una forte emissione nel lontano infrarosso. Non comunque forte a sufficienza da poter essere vista senza l’aiuto della lente gravitazionale.

«Grazie all’effetto di lente gravitazionale introdotto dall’ammasso di galassie fra noi e la sorgente, che agisce come se fosse un telescopio, dice infatti il primo autore dello studio pubblicato su Astrophysical Journal Letters, Anastasio Díaz Sánchez, ricercatore all’Upct, «la galassia sembra undici volte più grande e più luminosa di quanto non sia in realtà, e appare come replicata su più immagini lungo un arco, noto come “anello di Einstein”, il cui centro è la parte più densa dell’ammasso. Il vantaggio di questo tipo di ingrandimento è che non distorce le proprietà spettrali della luce, che possono così essere studiate su oggetti molto distanti come se fossero assai più vicini».

Per saperne di più:

- Leggi su Astrophysical Journal Letters l’articolo “Discovery of a Lensed Ultrabright Submillimeter Galaxy at z = 2.0439“, di A. Díaz-Sánchez, S. Iglesias-Groth, R. Rebolo e H. Dannerbauer

Articolo di Marco Malaspina originariamente pubblicato su Media INAF.

Deep learning al servizio dell'Astronomia, nuova frontiera

e di link) QUI.

e di link) QUI.

Antonio D'Isanto, primo autore di uno studio pubblicato su Astronomy&Astrophysics, ci spiega i progressi dell'Astroinformatica e come il suo lavoro potrà portare a interessanti scoperte scientifiche.

In diversi articoli pubblicati in precedenza abbiamo già avuto modo di discutere della nuova Scienza chiamata Astroinformatica e su come questa stia modificando radicalmente l'approccio verso la ricerca astrofisica. La grande quantità di dati disponibili richiede l'utilizzo di nuove tecniche per poterli analizzare ed estrarne informazioni utili.

Per questo motivo vorrei raccontarvi di un lavoro che mi sta particolarmente a cuore, in quanto primo autore, insieme al mio supervisore, il Dott. Kai Polsterer dell'Heidelberg Institute for Theoretical Studies. In questo modo vorrei poter attirare l'attenzione del pubblico su un aspetto della ricerca scientifica forse poco pubblicizzato, ma che riveste un ruolo fondamentale perché costituisce l'architrave su cui poggeranno molte ricerche in un prossimo futuro. Già il titolo del paper, accettato per la pubblicazione su Astronomy&Astrophysics, dovrebbe dire molto a chi sia un minimo avvezzo a queste cose: "Photometric redshifts estimation via deep learning" (letteralmente: Stima dei redshift fotometrici per mezzo del deep learning). Andiamo però con ordine e vediamo di capire meglio di cosa si tratta.

Per redshift si intende la misura dello spostamento verso il rosso nelle righe spettrali delle galassie, causato dal flusso di Hubble, ovvero a causa dell'espansione dell'Universo. In altre parole quello che misuriamo è una sorta di effetto Doppler: poiché tutte le galassie sono trascinate dall'espansione dello spazio in cui si trovano, a causa del Big Bang, la luce che emettono, e che misuriamo sotto forma di righe spettrali, viene spostata verso il rosso. Questa quantità è misurabile ed è appunto chiamata redshift.

Non solo, grazie alla legge di Hubble il redshift risulta direttamente collegato alla distanza di un oggetto, per cui conoscerlo equivale a poter misurare con grande precisione la distanza di una qualunque sorgente astronomica al di fuori della Via Lattea. Capirete come questo sia di fondamentale importanza per gli astronomi, in quanto guardare il cielo equivale a osservare un oggetto tridimensionale proiettato su una superficie bidimensionale, in cui ogni nozione di distanza è persa. La misura delle distanze costituisce pertanto la base per comprendere ulteriori proprietà fisiche di oggetti distanti come galassie e quasar.

Il problema sta nel fatto che le misure di spettroscopia sono molto complesse e laboriose, e in pratica abbiamo a disposizione redshift spettroscopici per molte meno sorgenti di quante ne servirebbero o, in generale, di quante ne osserviamo. Molti anni fa tuttavia gli astronomi si sono accorti che è possibile ottenere una stima del redshift indipendente dall'osservazione dello spettro, basata "semplicemente" sul flusso di luce che arriva a terra, misurato in diversi filtri. In termini astronomici, stiamo parlando di nient'altro che della magnitudine.

Il problema sta nel fatto che la relazione per calcolare il redshift fotometrico, così come viene chiamato, a partire dalle magnitudini, è altamente non lineare, quindi molto complessa, e la stima così ottenuta risulterà in ogni caso meno precisa del redshift spettroscopico, seppur sufficiente ai nostri scopi.

Di modi per svolgere questa operazione ce ne sono molti, ma uno dei più popolari ed efficienti è basato sull'utilizzo di reti neurali. Con questo termine si intende un software strutturato sul modello del cervello umano, in cui la principale unità di calcolo è chiamata appunto neurone. I neuroni sono organizzati in strati, rispettivamente di input, output e uno o più strati nascosti, dove avviene il calcolo vero e proprio.

Utilizzando dei dati di input e una serie di output noti la rete è in grado letteralmente di imparare a svolgere un determinato compito. In altre parole quello che si fa è dare in input le magnitudini di numerose sorgenti (nell'ordine delle decine o centinaia di migliaia) e in output il redshift spettroscopico, che quindi deve essere noto nella fase detta di "addestramento della rete". Quest'ultima potrà quindi calcolare il redshift fotometrico e valutare l'errore rispetto al redshift spettroscopico, cercando di minimizzarlo sempre più in cicli ripetuti, in cui i parametri interni della rete vengono opportunamente aggiornati. Alla fine il risultato dovrebbe convergere il più possibile verso quello desiderato.

Terminato l'addestramento la struttura interna della rete può essere congelata (ne vengono cioè fissati i parametri) e utilizzata per il calcolo "reale" nel quale non si conosce la risposta, ovvero per la quale il redshift spettroscopico non è noto.

Fin qui abbiamo parlato di storia. Ora però voglio raccontarvi cosa c'è di nuovo nel lavoro da noi pubblicato. Innanzi tutto utilizziamo il deep learning. Si tratta sempre di reti neurali, ma molto più complesse e in grado di svolgere operazioni diverse. Ciò naturalmente richiede molta più potenza di calcolo. Se una normale rete neurale può correre tranquillamente su una buona CPU, il deep learning richiede l'utilizzo di GPU per poter funzionare a dovere e in tempi ragionevoli. In particolare, nel nostro caso abbiamo utilizzato un'architettura basata su nVidia Titan X per gli esperimenti.

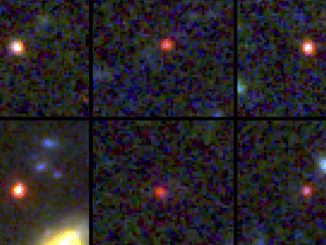

Ovviamente questa scelta non è dovuta a puro "capriccio" accademico, ma voleva soddisfare delle necessità. In primis, l'idea di base del lavoro era di utilizzare non le semplici magnitudini, bensì le immagini originali. Le magnitudini infatti non sono altro che una parzializzazione dell'informazione originale contenuta nelle immagini degli oggetti. Più informazione vuol dire, ragionevolmente, un risultato finale migliore. Per questo motivo abbiamo utilizzato un particolare modello di deep learning, chiamato convolutional neural network (ovvero rete a convoluzione profonda), particolarmente utile quando ci si trova a utilizzare immagini come input.

Inoltre, modificando opportunamente la nostra rete neurale abbiamo fatto in modo di ottenere non semplicemente una stima del redshift fotometrico, bensì una distribuzione di probabilità. Questo perché la natura stessa del redshift è degenere. In parole povere, per varie ragioni fisiche non esiste una misura unica del redshift, ma più misure alle quali è associata una certa probabilità.

Questo tipo di modello risulta pertanto molto più preciso e descrittivo del fenomeno in questione e i risultati che abbiamo ottenuto, confrontati con i modelli classici, mostrano difatti un grande miglioramento nelle prestazioni. Inoltre l'utilizzo di una rete siffatta ci ha permesso di ottenere stime di redshift direttamente dalle immagini, senza necessità di alcun tipo di trattamento iniziale dei dati, in modo completamente automatizzato, per un gran numero di sorgenti (nei nostri esperimenti utilizzavamo diverse centinaia di migliaia di oggetti).

Infine, l'altro grande vantaggio sta nel fatto che solitamente i modelli utilizzati finora richiedono una pre-classificazione degli oggetti. Ciò vuol dire che occorre prima distinguere le galassie dai quasar e dalle stelle.

Con questo modello invece è possibile "dare in pasto" alla rete immagini di oggetti diversi, indipendentemente dalla loro natura, e il processo di estrazione del redshift funziona dignitosamente anche in questo caso, che risulta, come potrete capire, molto più vicino a una situazione reale.

Il prossimo passo ora sarà quello di utilizzare una rete già addestrata per calcolare i redshift fotometrici per tutti gli oggetti contenuti nel database della Sloan Digital Sky Survey: qualcosa come un miliardo di sorgenti, mettendoli a disposizione della comunità.

In conclusione, mi rendo conto che lavori di questo tipo possono sembrare a prima vista meno interessanti e affascinanti di quelli sui buchi neri o sulle onde gravitazionali. Tuttavia, è partendo da queste cose che si riesce poi a studiare tutto il resto. Inoltre quello dei redshift fotometrici è sostanzialmente un caso applicativo, ma questo tipo di tecnologie può essere utilizzato in svariati campi dell'Astrofisica. Anzi, la speranza è proprio questa: che in un prossimo futuro si riesca ad automatizzare il più possibile i processi in modo da estrarre conoscenza da una quantità tale di dati che in caso contrario andrebbe semplicemente sprecata, perché nessuno sarebbe in grado di metterci le mani.

Articolo originale (con un po' più di figure

Ringrazio per la preziosa collaborazione corrado973.

Bellissimo argomento. Grazie a Svelo per avermelo portato all' attenzione

Corrado

insomma Svelo a Corrado, Corrado a Red...

a chi dobbiamo ringraziare?

Tutti e tre!